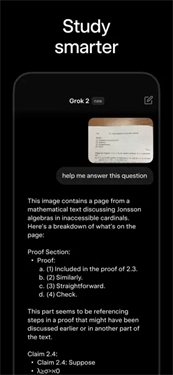

xAIGrok3是xAI公司最新推出的人工智能大模型,它具备极为出色的推理能力,能通过对数据的反复梳理达成逻辑上的连贯统一,像人类认知事物那样逐步拆解并处理复杂任务。和Grok2相比,Grok3在编程、文本分析、图像分析等方面的能力有了进一步提升,用户还能与Grok3聊天机器人展开对话,各类问题都能获得精准解答。Grok3不仅功能完备,界面也清爽简洁,想要获取更多安卓手机软件资源,欢迎前往12365网!

Grok3什么时候发布

Grok3将于太平洋时间

2025年2月17日晚上8点

发布,届时将进行现场演示

Grok大模型部署教程

1、硬件要求

Grok-1具备3140亿的庞大参数量,这使得它的运行对硬件配置有较高要求。经估算,运行该模型至少需要配备628GB GPU内存的机器。所以,在部署Grok-1之前,务必确认您的硬件能够满足这些配置条件。

2、软件环境搭建

安装所需的库:为了能运行Grok-1的自定义训练堆栈,你需要安装JAX库、Rust环境等必要的软件库。

模型文件:即来自xAI官方GitHub仓库(链接为https://github.com/xai-org/grok-1)中关于Grok-1的模型权重与网络架构相关文件。

配置运行环境:依据您的操作系统与硬件配置情况,对适配的环境变量及运行参数进行设置。

3、模型部署与测试

模型部署:把对应的模型文件存放到合适的目录里,再依据xAI给出的指南完成模型参数的配置。

进行测试运行:可以借助给定的示例代码,或者自行编写脚本,以此来对Grok - 1的性能展开测试。在测试期间,要留意查看模型的响应快慢以及结果是否准确等方面的指标。

调整与优化:依据测试反馈的结果,对模型参数进行调整或者对运行环境加以优化,从而进一步提升模型的性能表现与运行稳定性。

Grok大模型运行条件

1、硬件要求

Grok大模型包含3140亿个参数,运行时对GPU内存的需求极高。若按每个参数占用2字节来估算,其基础内存需求约为628GB。而在实际部署场景中,显存消耗往往会更高——比如采用FP16精度时,这一需求甚至可能达到700GB左右。

关于GPU的型号与数量配置,建议优先选用NVIDIA A100显卡,该显卡单卡显存容量为80GB。若要运行Grok大模型,硬件配置需满足以下条件之一:配备至少8张A100显卡,或者搭配4张A100显卡及512GB的内存。

2、软件环境

在深度学习框架方面,Grok大模型能够借助PyTorch、TensorFlow这类工具,实现模型的加载、运行以及优化等操作。

兼容的代码库:需获取并编译xAI所提供的开源代码,以保证能够正确加载和使用Grok-1模型

Grok大模型需要的配置

1、GPU显存:Grok大模型的运行对显存容量有较高需求,其最低配置要求大约是630GB显存,而在FP16精度模式下,所需显存甚至可能会达到700GB。

2、GPU数量:以ChatGLM130B模型的硬件需求为参照基准,运行Grok大模型预计需要配备20张A100 GPU(单卡显存40GB),或是20张V100 GPU(单卡显存32GB)。

3、CPU:建议采用多颗Intel Xeon系列处理器,像Intel Xeon Silver 4310这类型号就很合适,能为系统提供充足的计算性能支撑。

4、内存:系统运行所需内存最低为32GB RAM,不过从运行效率与稳定性的角度考量,更推荐配置容量更大的内存。

5、存储空间:存储模型权重及相关文件需至少100GB的可用空间。

6、操作系统:推荐采用Linux或macOS操作系统。

7、软件依赖:需安装Python 3.8及以上版本、pip、CUDA 11.0及以上版本,还有JAX这类高性能数值计算库。

Grok3软件功能

自然流畅的智能对话,帮助用户答疑解惑。

拥有深度思考的能力,会先对问题展开分析与思考,之后再给出回答。

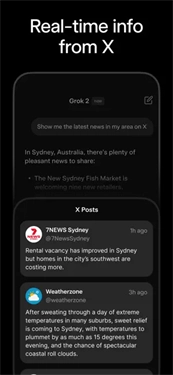

支持全网搜索功能,可助力用户实时获取各类所需信息。

Grok3软件优势

先进的自然语言处理技术,能够更精准地把握用户的需求与疑问,进而提供更贴切的回应。

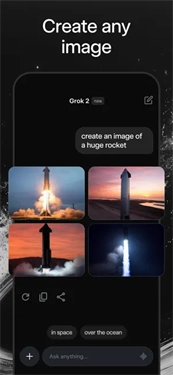

生成多种类型的文本,如新闻、小说、诗歌等,具有较高的多样性和创造力。

能依据用户的具体需求来进行个性化定制,像生成特定风格的文本、解答特定领域的问题之类的情况都包含在内。

不断学习和优化,提高自己的生成能力和回答准确性。

Grok3软件亮点

高效回答用户问题,自动生成高质量的文章和内容。

分析用户行为和偏好,推荐最相关的内容和信息。

提供编程语言、算法等领域的代码示例和调试帮助。

Grok3软件评测

Grok3是一款极具实力的AI聊天机器人,它具备深度思考的能力,能够轻松应对各类推理问题,而且Grok3大模型在内容生成和对话问答这两个方面也有着显著的进步。

Grok3软件评测

v0.4.192026/5/12

DeepSearch现已可用。

额外的登录选项,改进以恢复您的对话。

改进输入栏、年龄选择器和错误消息。

软件截图

猜你喜欢

-

健康东莞

健康东莞

27.07MB实用工具

-

汉小印

汉小印

36.7MB实用工具

-

过客软件园

过客软件园

1.14MB实用工具

-

蓝奏云优享版

蓝奏云优享版

1.07MB实用工具

-

Apktool M汉化版

Apktool M汉化版

15.13MB实用工具

-

MyCadillac

MyCadillac

292.15MB实用工具